【长假特刊】大语言模型如何改变一代「信息工人」?|Digital Explorer#014

Editor’s Note

今天是 2023 年 9 月 26 日,您正在阅读的是第 14 期 Digital Explorer (原第 177 期 iPad Power User)。

马上就是「中秋+十一」长假了,2023 年前 9 个月,大语言模型已深刻影响到数字工具的方方面面。作为一份聚焦数字工具使用的邮件通讯, Digital Explorer 在长假前推出一期特刊,以大语言模型如何改变一代信息工人——比如我——的视角,全面梳理大模型对于信息处理流程、工具的影响与潜在趋势。

本期内容比较长,不妨先收藏起来,作为这个即将到来长假里的阅读资料也未尝不可,接下来,欢迎和我一起探索大模型与数字工具之间的神奇反应。

📱 信息消费

各类数字设备上的信息消费几乎是当下每个人每天甚至每分钟都在做的事情,而各类大语言模型正在深刻改变信息消费的场景与方式。

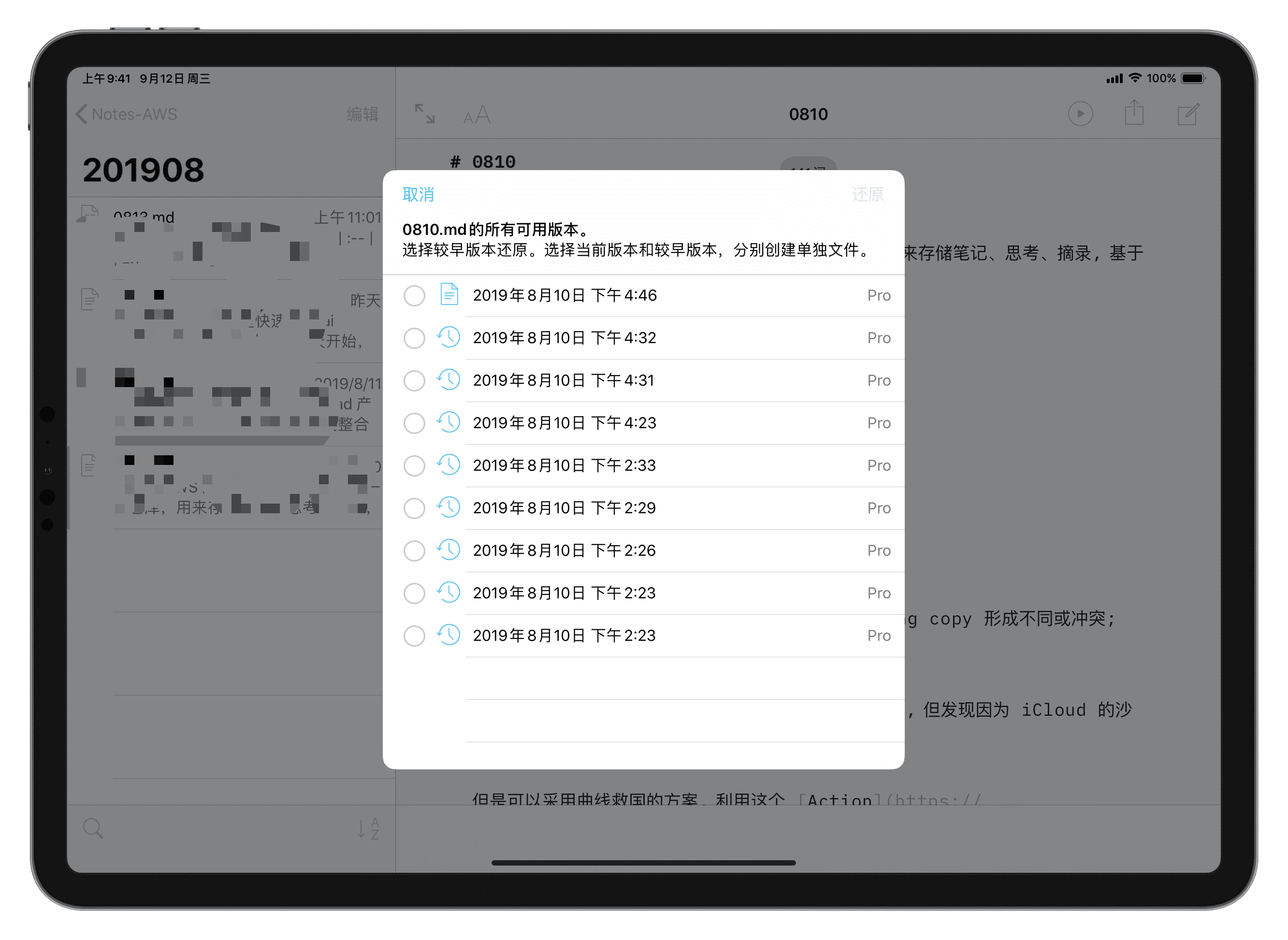

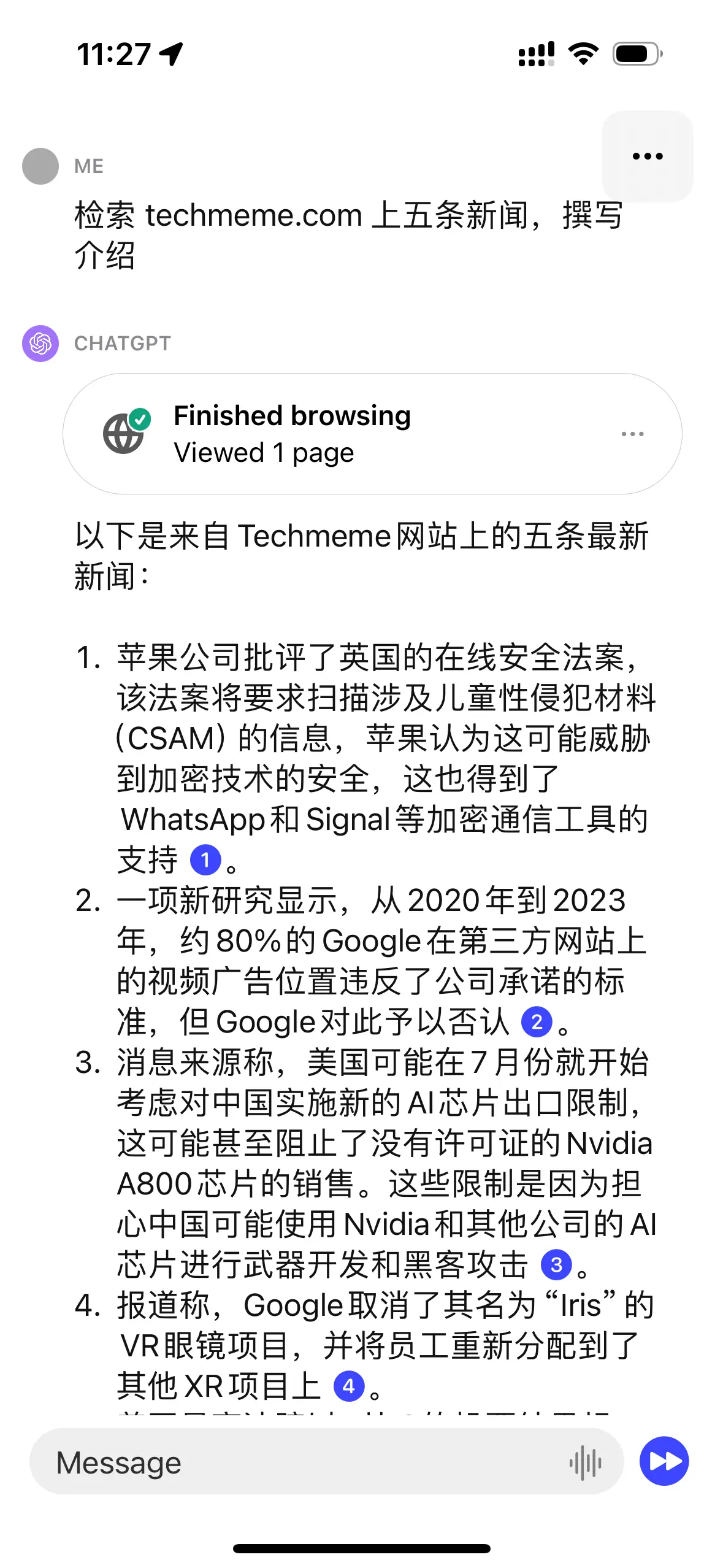

比如,获取新闻的方式就在悄然发生变化。过去,获取新闻信息需要打开特定网站,逐篇浏览。现在,通过语言模型提供的插件或应用,用户可以直接取得所需新闻,使用 ChatGPT 的 WebPilot 插件,输入关键词即可检索指定网站,快速获取最新消息,如下图所示:

再比如,用户不再仅仅通过关键词搜索到一堆网页链接,而是可以利用对话的形式,直接获得所需要的信息。微软新 Bing 和 Google SGE 都可以实现类似的效果,后者支持图像和视频内容,用户还可以看到这些回答里的来源链接:

这是生成式 AI 带给信息消费场景变化的一大体现,更进一步,我们也在通过各类大语言模型重建「巴别塔」——让语言不再是获取信息的障碍。

以浏览其他语言的网页为例,可通过「浏览器扩展+翻译服务免费 API」的方式快速、低成本地让语言转化过程一键完成,以下是一组浏览器扩展:

- 划词翻译:一款浏览器扩展,可调用多个云服务的翻译能力,还能和各类词典实现协同;

- OpenAI Translator:这款浏览器扩展的最大特点是对 OpenAI API 的支持,其中网页 ChatGPT 模式能够调用 OpenAI 为移动端提供的 ChatGPT 模型,翻译速度非常快;

全球主要云计算服务商都有一定额度免费的翻译服务,比如:

- 微软 Azure 云服务 200 万字符/月(新用户前 12 个月);

- 腾讯云 500 万字符/月;

- 字节跳动的火山翻译 200 万字符/月;

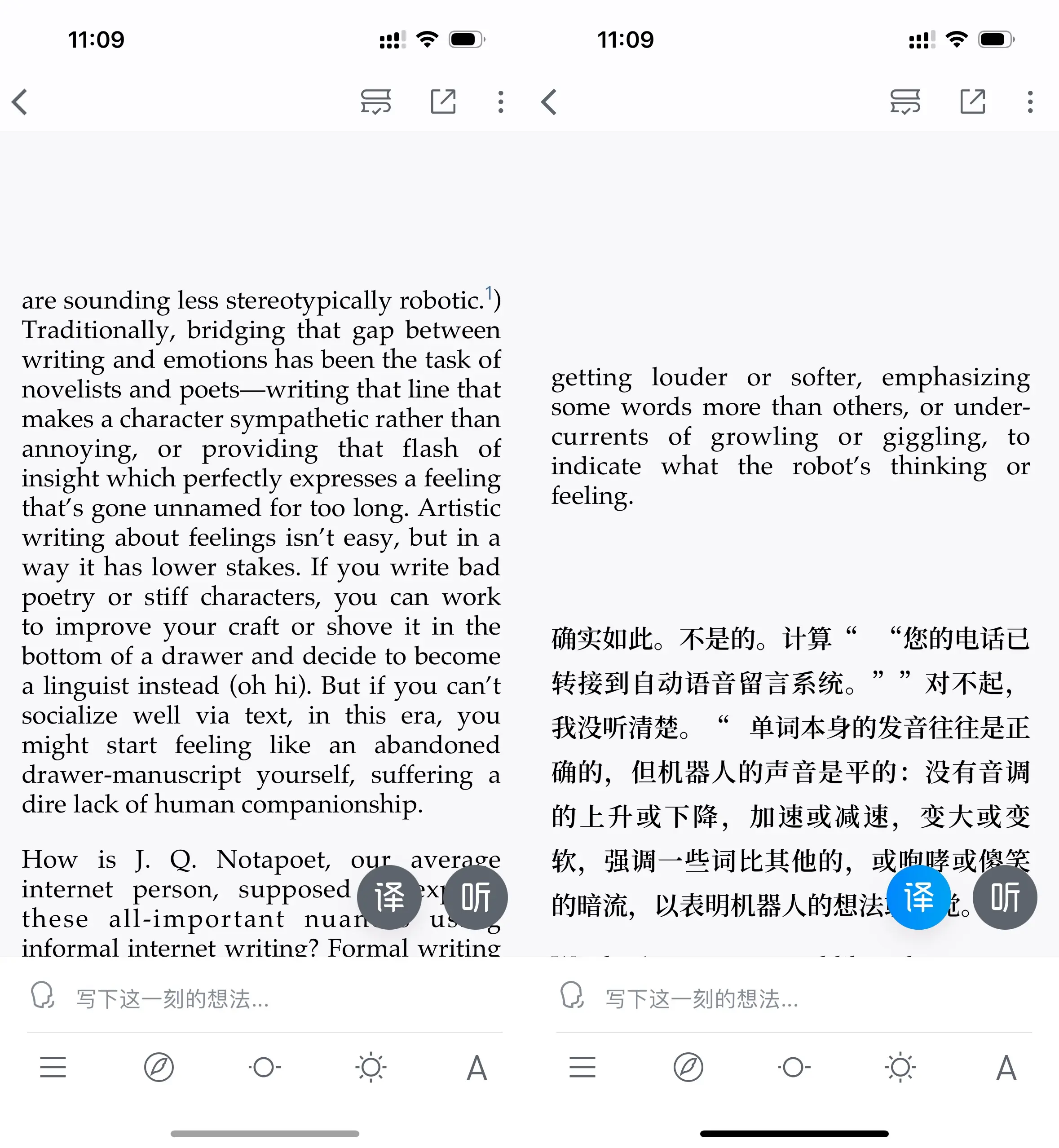

大语言模型还在深刻改变阅读英文图书的场景,如果你经常使用「微信读书」,那么一定会注意到一个新功能:当用户上传英文或其他非中文图书的时候,「微信读书」应用会自动将其翻译为英文。

你也可以在阅读的过程中灵活切换中英文显示,除此之外,我还推荐其他几个英文图书翻译的工具:

- 沉浸式翻译:基于浏览器扩展或油猴脚本,可调用包括 OpenAI 在内的众多翻译服务,甚至可以在 iOS 上完成一本书的翻译工作;

- Ebook Translator:这是一款电子书管理工具 Calibre 的插件,通过调用 Google、OpenAI、DeepL 的翻译引擎,直接在 Calibre 里实现不同语言图书的翻译;

- bilingual_book_maker:无需安装软件,直接在终端里使用命令行调用 OpenAI 的 API 即可;

上述三个产品都需要自己申请不同翻译服务的 API,相对复杂和繁琐。下面是几个封装后端接口、直接提供图书翻译服务的产品,费用相对高一点,各位可根据自己的需求灵活选取:

语言之间的转换之外,还有一类信息形态的转化——文本转音视频,或者音视频转文本。这些不同形态的内容能够满足不同场景的需求。

此前,这类转换的成本——包括时间成本和服务成本——都很高,但大语言模型改变了这一切,还将体验上升了几个等级,比如如何让设备把网页内容读出来,可使用微软桌面的 Edge 浏览器,借助微软强大的语音合成能力,收听任何网页内容,中英文的朗读效果非常棒。

iOS/Android 平台的新闻应用 Artifact 也提供了免费读新闻功能,相比传统的如 Pocket 这类产品,Artifact 的阅读音色更棒,或者可以说可以提供更自然的声音,比如拥有两位名人的声音:说唱歌手 Snoop Dogg 和知名演员 Gwyneth Paltrow(曾饰演电影《钢铁侠》里的「小辣椒」)。

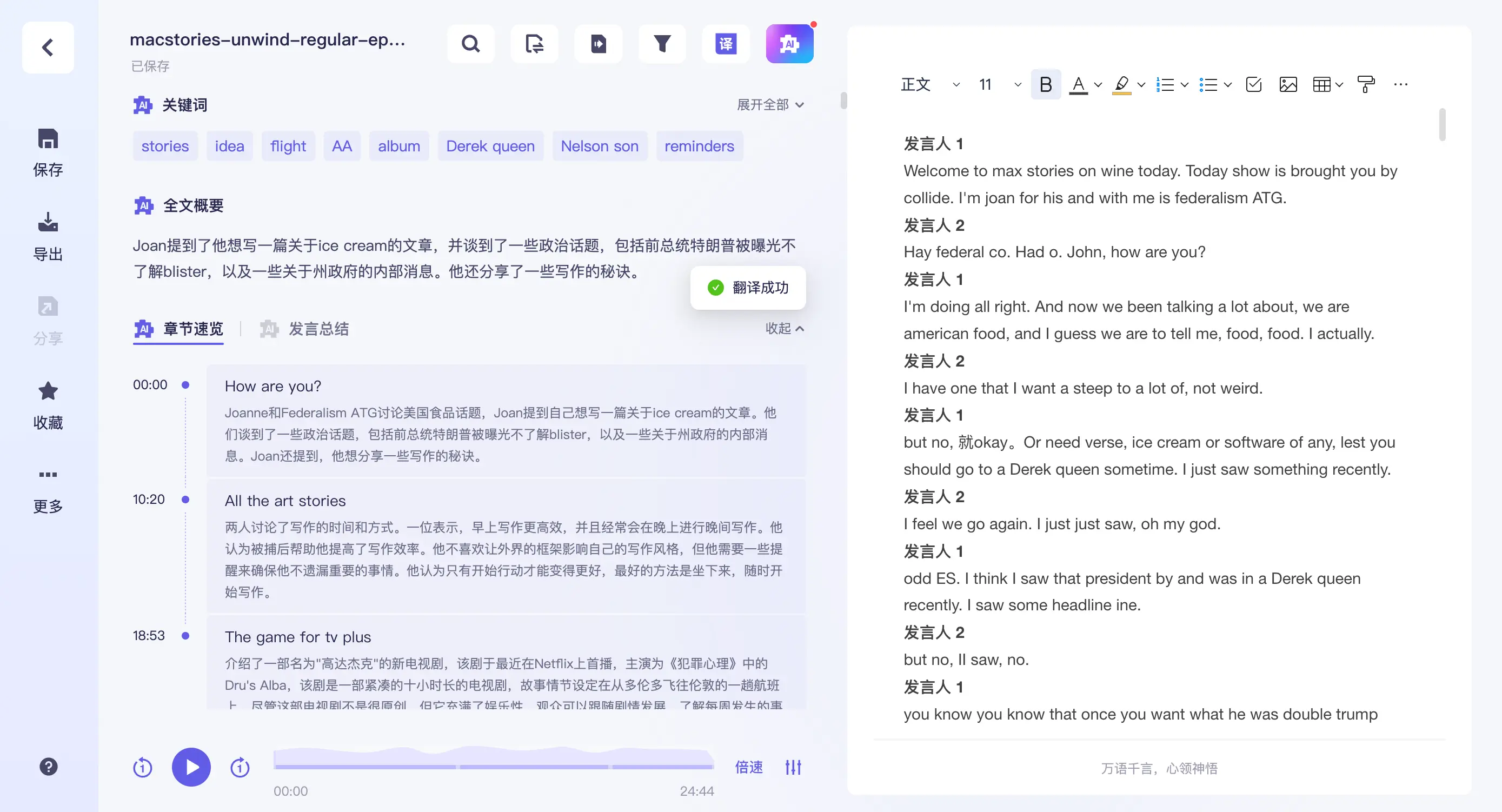

接下来看看如何从声音转换为文本,我今年收听播客的一个习惯是使用「通义听悟」,快速把声音内容转为文本内容。

举个例子,我会将一些来不及听的播客节目,以 mp3 的格式下载到本地,然后导入到「通义听悟」里生成文本。此时你既可以边看文本——或者是字幕——边听播客,还可以借助各类大语言模型应用,快速处理这些文本内容,比如生成摘要或整理成文等等。

类似的,飞书旗下的「飞书秒记」也能实现类似的效果,各位可根据自己的喜好灵活选择。

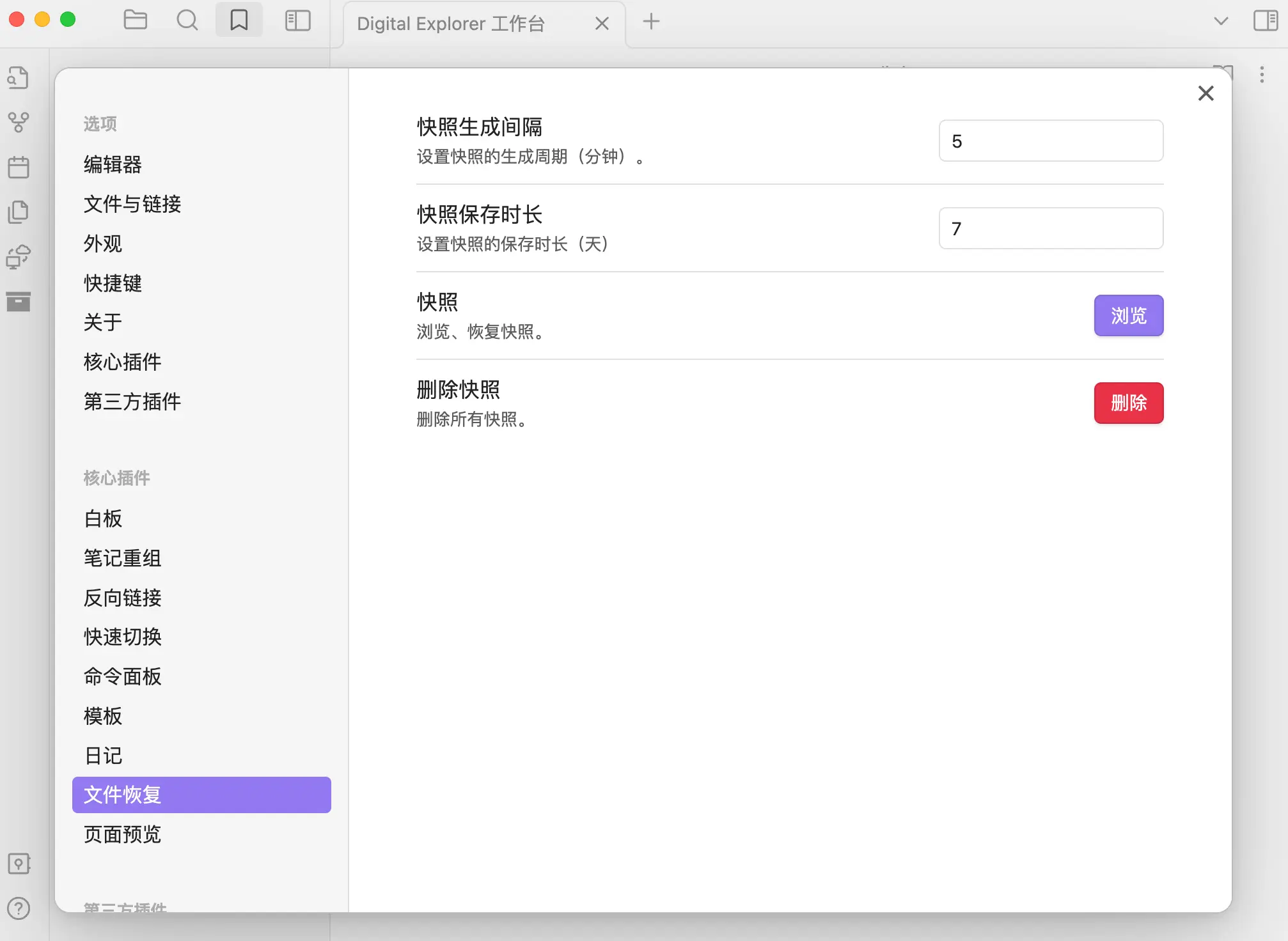

📔 信息加工

前几天投资机构 a16z 的一份分析里指出,当前绝大多数大模型类应用在一年前都不存在,这个结论让我有点恍忽,但事实的确如此,你不妨想想,一年前的十一长假,你在使用哪些大模型应用?

而在一年后的十一长假,我们触手可及的大模型应用数不胜数,从国内大厂到海外巨头无一不在布局相关产品,并提供免费/付费、开箱即用/API 调用等多种选择。

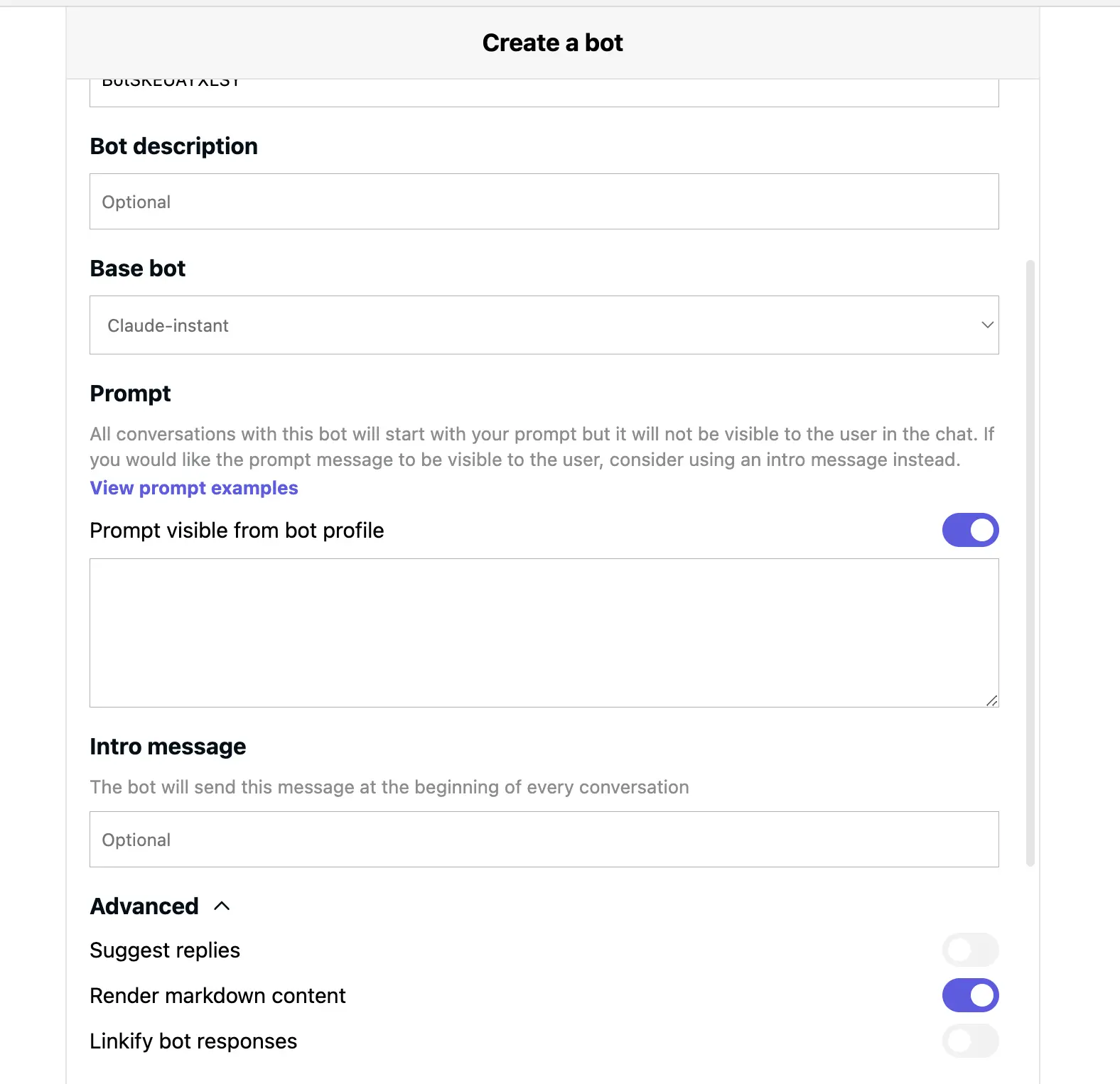

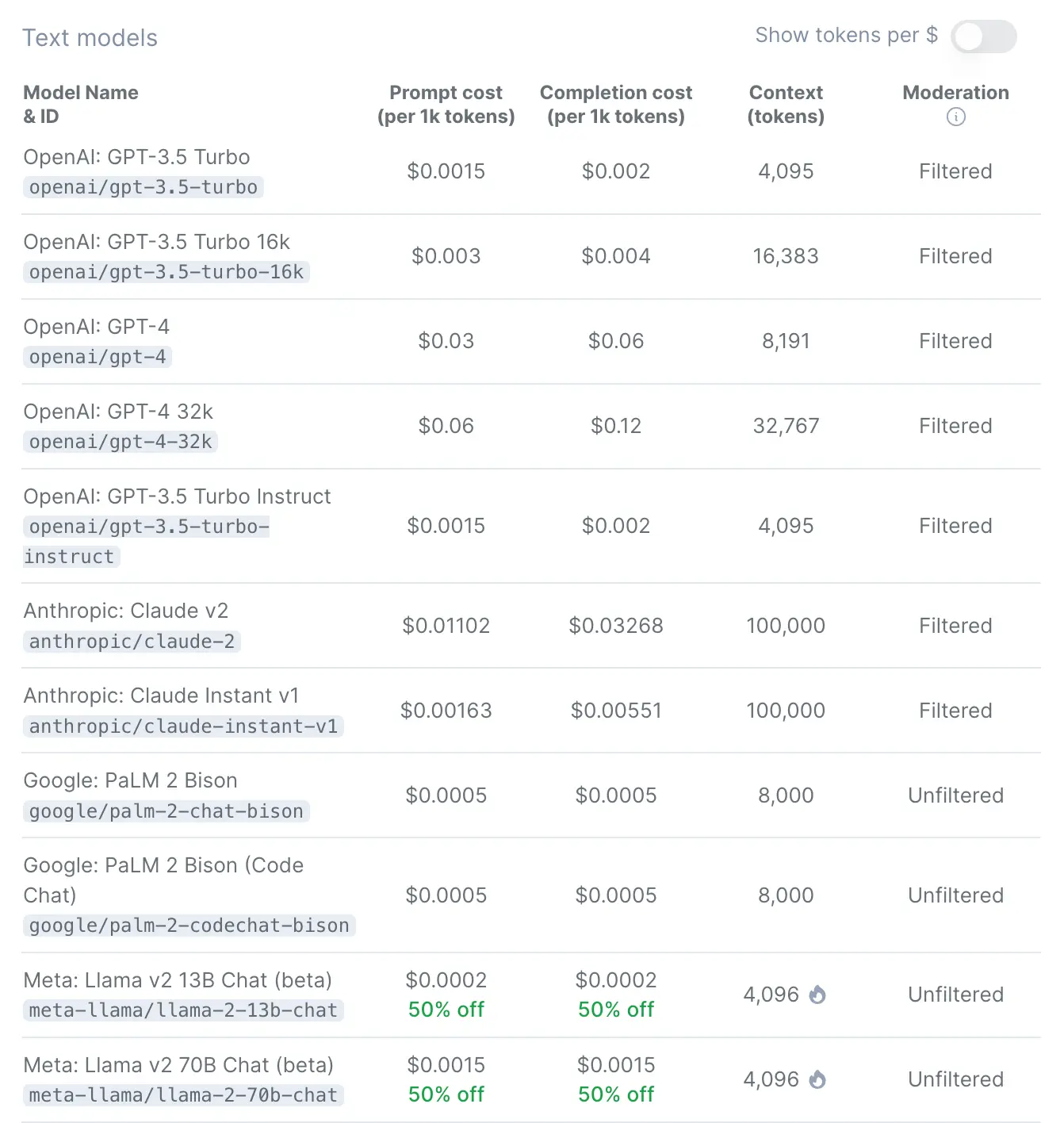

这半年来,我一直向身边的朋友以及各位读者推荐应用「Poe」,因为它足够简单——不仅上手简单——付费也非常简单;而且功能还在不断迭代,支持的模型也越发丰富,在本期内容截稿的时候,应用「Poe」支持以下模型:

- OpenAI 旗下的 ChatGPT、GPT-3-16k、GPT-4、GPT-4 32K;

- Anthropic 旗下的 Claude Instant、Claude-1-100K、Claude-2-100K;

- Meta 旗下的 LLaMA-2 7B、13B、70B 三类模型,以及 Code-LLaMA 7b 和 13B 模型;

- Google 旗下的 PaLM;

这其中,绝大多模型服务都可免费使用,部分需要付费的模型服务每天还有免费额度的使用权限,对于轻度用户来说是个不错的选择。

另外,「Poe」还支持自定义聊天机器人,即便是免费用户,你依然可以定义不同的模型,通过不同规格的模型、模型温度、自定义提示词、回答渲染效果等方式构建起一个个适合不同场景的机器人,官方教程在这里。

值得一提的是,应用「Poe」的高级版订阅价格为 20 美元/月(不同地区的价格略有差异,但没有太便宜的),可同时获得业界最强的两家公司——OpenAI 与 Anthropic 提供的最强大模型使用能力,而且付费之后,理论上可以使用无限的 GPT-4 或 Claude-2-100 K 的能力,相比 OpenAI 或 Anthropic 公司的付费产品,我更推荐为应用「Poe」付费。

应用「Poe」解决了大模型开箱即用的问题,但可能还有一些需要借助 API 的场景,OpenAI 提供了付费 API 的调用服务,但支付方式非常苛刻,对于包括中国在内的很多地区用户来说是一个不小的障碍。

微软 Azure 的 OpenAI 服务算是一个不错的替补。申请门槛比较低,而且付费简单,直接使用国内信用卡即可支付,价格和 OpenAI 官网一致。现在基本注册,基本会直接发放 GPT-3.5 的 API 访问权限,GPT-4 可能需要一点时间,但最近微软放出很多名额,值得一试,推荐一个申请教程。。

另一个替补是我一直在用的 OpenRouter,它集成了Claude V2 API、GPT-4 在内的众多 API 访问能力,价格与官方 API 一致。

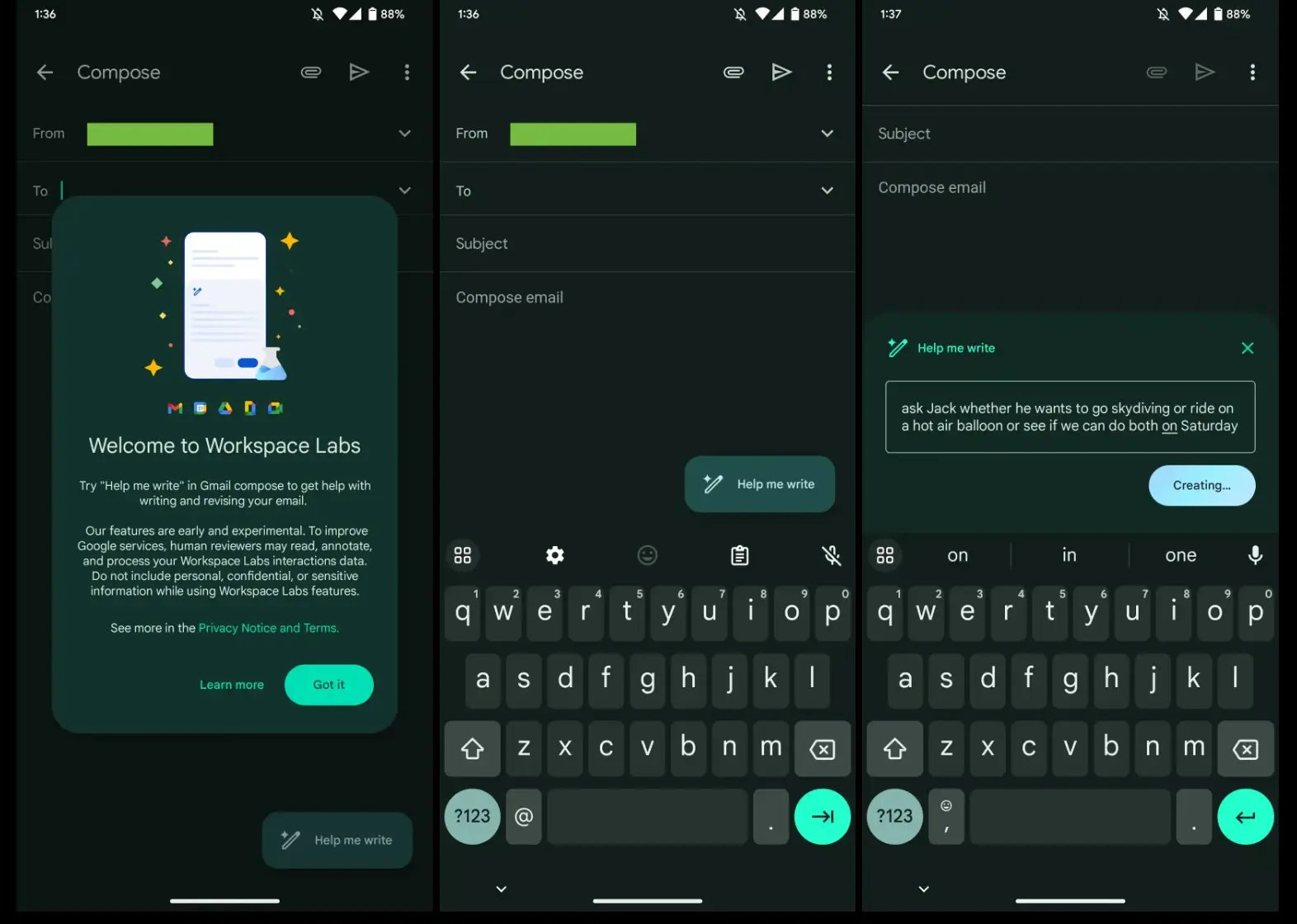

大语言模型不仅开创了一种全新的应用品类,还在深刻影响众多效率类应用的进化方向,比如邮箱应用,iOS 上的邮箱应用 Spark 已经将大模型能力集成到产品里,如下图所示,你可以在编写邮件时,直接启用 AI 助手,目前提供复述、校对等功能:

Google 旗下的 Gmail 也在陆续推送基于 AI 的「帮我写」新功能:

所有这些让 AI 撰写邮件的功能,本质上都是基于特定提示词的场景创新。或者换句话说,用户完全可以在诸如 ChatGPT 的聊天框里使用「提示词+邮件草稿」的方法实现类似的效果,但这一类创新——「特定提示词+特定场景」——会越来越多,它为用户创造了使用 AI 模型的场景,同时又改善了原有应用的用户体验。毕竟,ChatGPT 这样的聊天窗口,并不是大模型交互的唯一方式。

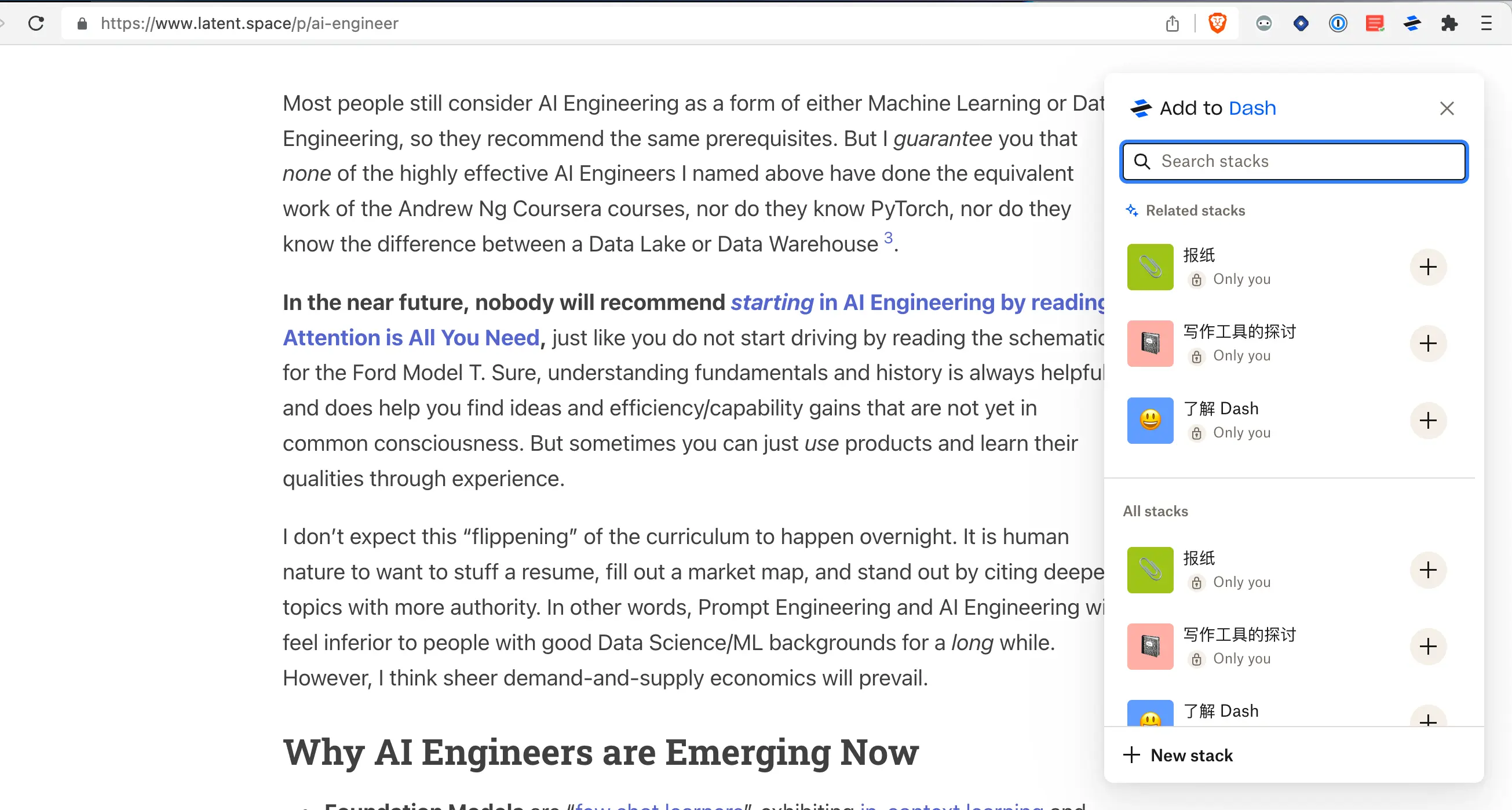

另一个值得关注的领域是文件管理,Dropbox Dash 就是目前最具代表性的应用,它由两部分组成:

- 客户端应用;

- 浏览器扩展;

两者的作用有一定区别。客户端应用是一个搜索引擎,可随时通过快捷键「Cmd+E」调出,能够检索用户授权的各类云服务以及本地文件或数据,不仅支持文件名称,还能在一定程度搜索文件内的关键信息。

浏览器扩展则更像是一个网页收集工具,Dropbox 使用「Stack」这个名字描述用户收集的不同主题内容,如下图所示,安装该扩展之后,你可以将任何网页添加到 Dropbox Dash 里。

Dropbox 也将 AI 能力「悄悄」集成到上述两个工具里,用户敲下的每个字符以及做的一切操作都可以看作是一类调用模型的「提示词」,Dropbox Dash 会不断做出回应。一个比较典型的场景就是在处理 Stack 的时候,Dropbox Dash 会根据用户已经收集的网页内容推荐其他相关的网页(目前仅限于之前的历史记录)。

Dropbox Dash 展示的不仅是这家云存储公司对于 AI 大模型风口的追逐,更有着一个巨大的野心,那就是通过帮助用户打通文件和数据在不同服务之间的割裂关系,构建起一个全新的工作台:

- 用户在这个工作台上检索文件或数据,无所谓本地还是云端,也无所谓在哪一个云服务里;

- 用户利用快速检索到的文件构建起第一层联系(也就是 Stack);

- 用户不断挖掘这层联系,并通过新文档展示新关系,Dropbox 其实并不在乎你是否在它的应用里创建文档,它只需得到用户授权,可读取文档即可。

当然,我们没有理由怀疑苹果、Google 不跟进这个领域,何况两家公司都握有操作系统级别的文件访问权限,或许苹果暂时还不会在 macOS 上为自家的 Spotligt 搜索加入更多 AI 能力,但鉴于苹果内部已经在研发大模型架构和聊天机器人项目,明年 6 月 WWDC 会成为 macOS 乃至 iOS 更新系统搜索的重要场合。

Google 更不必多提,这家以搜索起家的公司,接下来一定会在移动搜索(Android、iOS)、桌面搜索(包括 ChromeOS)等领域持续发力。

通过更自然的方式,帮助用户快速找到文件、获取文件、打开文件,将成为接下来文件管理的关键。

✍️ 信息创造

去年 12 月初,我在体验一周 ChatGPT 之后写了一篇会员通讯,谈到 ChatGPT 可能对内容创作者——特别是文字内容创作者——的价值,这将是一种范式的变化:

- 人类负责思考,写出关键词;

- 语言大模型负责呈现这些思考,输出文本;

- 人类校对这些输出的文本(或者,让另一个模型校对?);

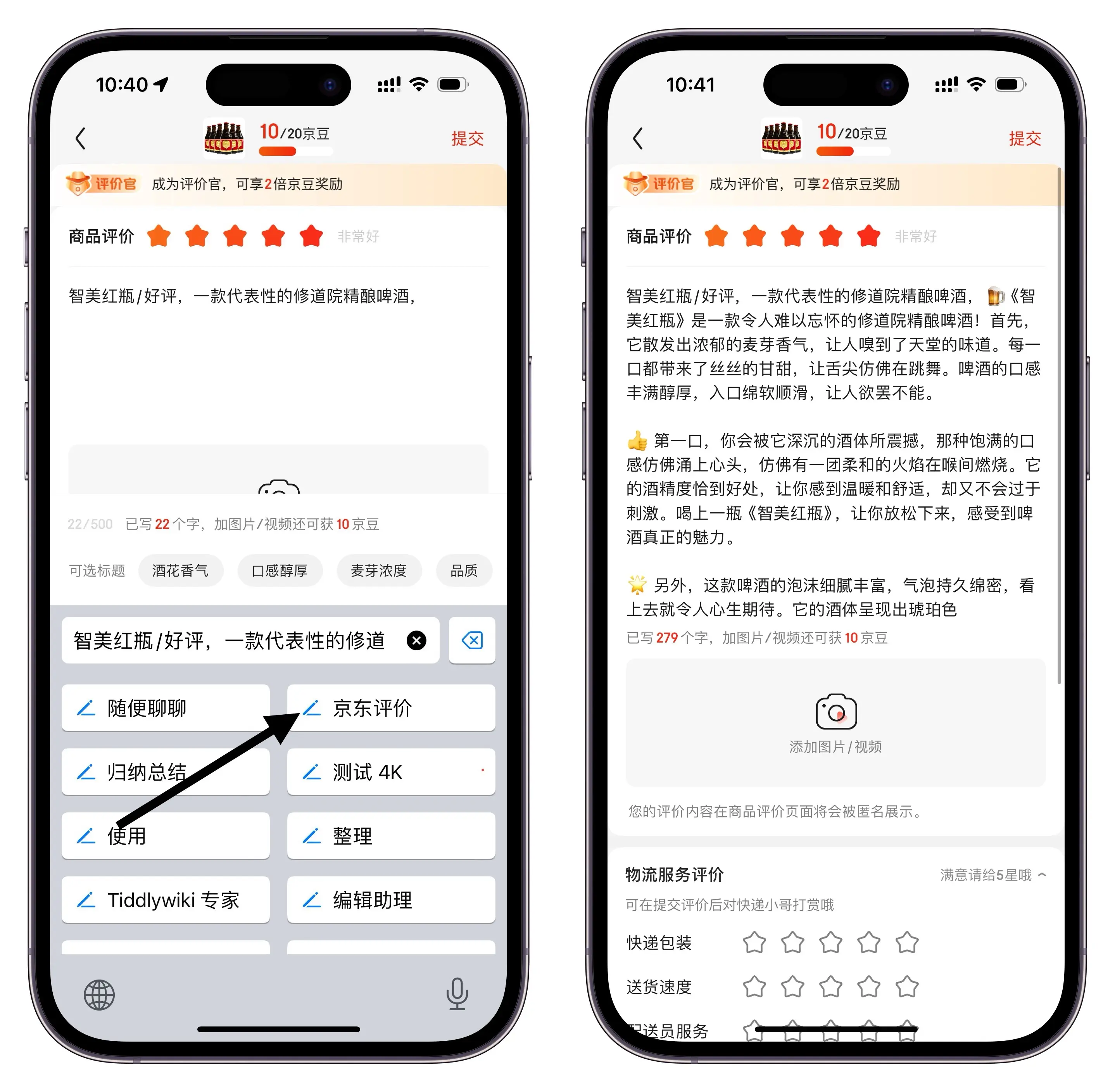

随着各类大语言模型的持续迭代,我的内容创造流程也在被重新塑造,比如在 iPhone 上,我把 Open

Cat 作为一类「输入法」。严格意义上说,它只是一款基于 OpenAI API 的大模型应用,用户可以将自己申请的 OpenAI API 或 Azure 的 OpenAI Service API 填入其中(目前也支持了 Claude API),然后通过自建提示词或内置的 AI 工坊——含有大量提示词示例——快速调取大模型的能力。

但我觉得它最有趣的地方是将大模型能力延伸到输入法里,你可以将其作为输入助理,下图展示了我在 Drafts 里的场景,此时 OpenCat 是在帮我思考:

另一个有趣的应用场景在特定应用里调取特定提示词,比如在电商评价里,你只需输入产品名称、评价等关键词(左图),然后让模型帮你生成内容即可(右图),当然生成的内容不可能是完美的,还是需要你手动做一些修改:

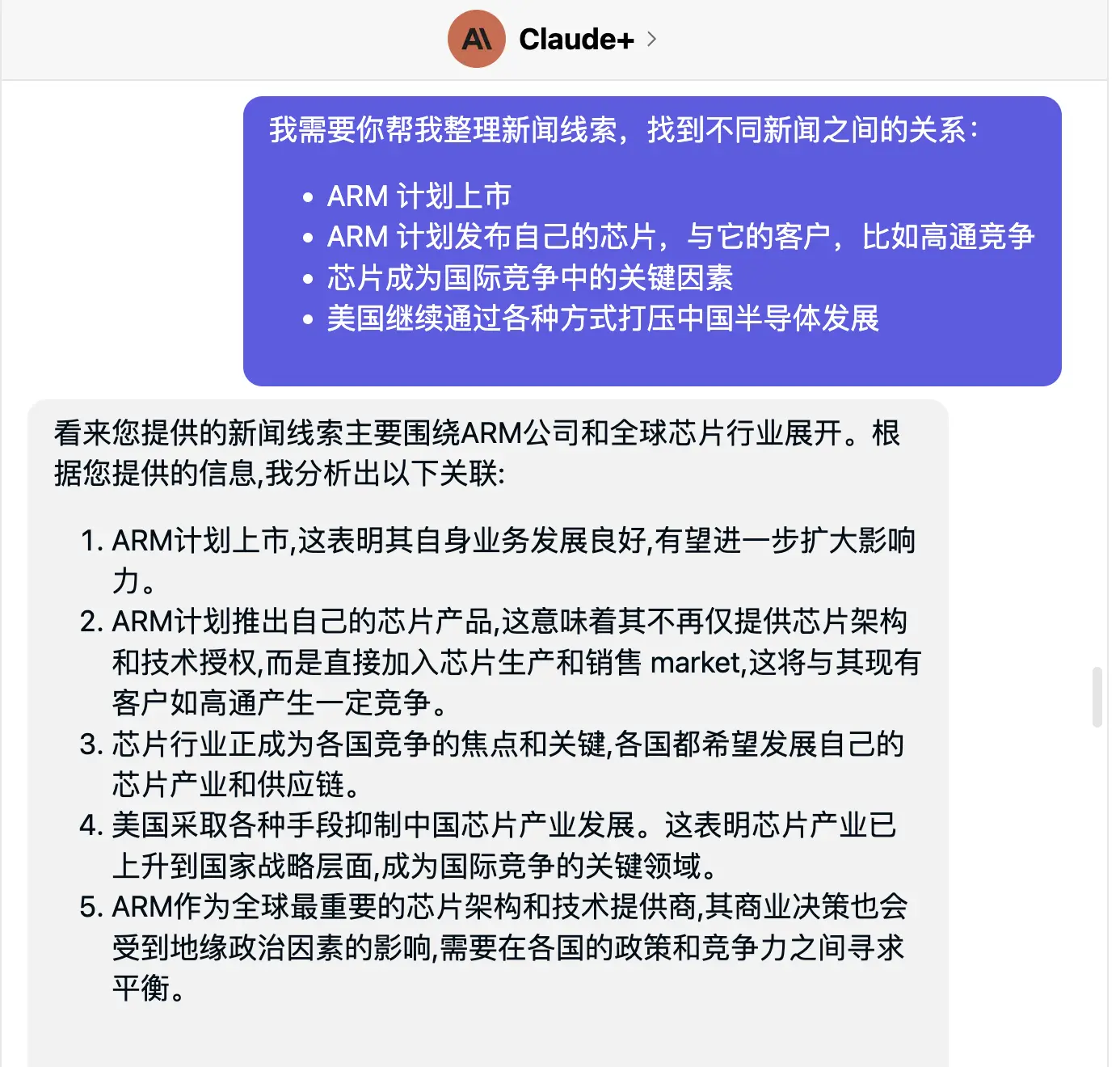

在更适合内容创造的桌面设备上,大模型带来的价值更大,比如把新闻线索告诉给大模型应用——以 Poe——为例,让其帮我整理一些潜在的线索:

在使用大模型进行内容创造的过程中,我的一个迫切诉求是如何让大模型「记住」我,包括我的内容关注点、思维模式等等。很长一段时间里,我都需要在每次与大模型对话的时候复制、粘贴自我介绍,姑且不提过程复杂,还会因为占据了太多上下文而影响到模型回复的质量。

ChatGPT 的 Custom instructions 很好解决了这个问题,无论你是免费还是付费用户,我都建议各位使用这个功能:

如上图所示,它包括两个部分:

- 介绍你自己:我将自己关注哪些内容、思考方向以及使用了哪些工具等内容放在这里;

- 告诉模型如何回复你:在这里定义模型输出的格式、风格或者其他风格等。

你可以充分利用这两处 3000 个字符的空间,它不会占据上下文长度,还可根据自己需求的变化随时调整,然后再开启新对话的时候就会根据 Custom instructions 的新内容进行回复。

通过灵活设置 Custom instructions,我发现能够有效降低 ChatGPT 出现幻觉的频率,进一步提升 ChatGPT 的可用性。

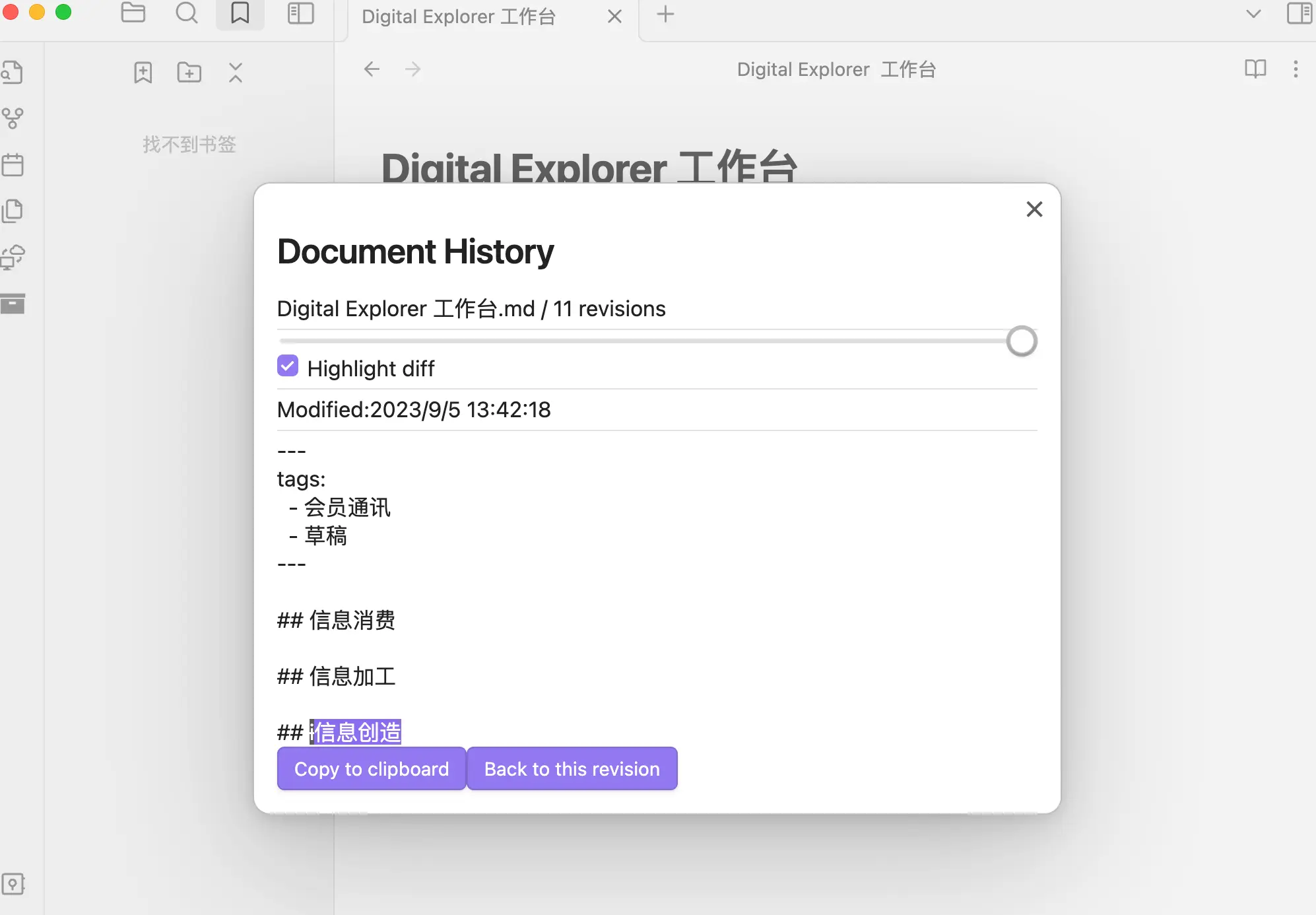

其次,大模型进一步优化了我对过往内容的提炼和分析,从而找到更多内容创作新灵感。网页版的 Claude ai 拥有 100K 上下文的交互能力,大约相当于 75000 英文单词,或者说 15 万中文左右。

由于 Claude 支持上传附件文档,我也大可不必再像之前那样复制粘贴文档,直接将过往的会员通讯存档上传即可开始提炼、分析:

再比如利用微软 Edge 浏览器与 Bing 的组合,直接将 Bing 固定在浏览器右侧,作为访问网页的「智能助理」,然后使用 Edge 浏览器直接读取一份过往邮件通讯的文本存档,既可以分析内容,也可以快速生成内容:

这个过程让我想到很多东西:以 ChatGPT 为代表的大语言模型的快速迭代,可能会超过很多科技乐观主义者预测;在属于「我的地盘」的内容创作的场景中,基于 GPT-4 的语言能力、网络插件的信息检索能力,使用 GPT-4 写一篇文章甚至一本书(大纲)已经不再是一件难事,而且这种能力还在不断进化和提升,更重要的,所有这一切的成本,都被包含在每月 20 美元的订阅费用里。

但又回到一个古老但被不断提及的问题:人类会失去自己的位置吗?或者说,在写作的场景里,人类作家会失业吗?

这个问题足够庞大,也足够敏感。回顾历史的话,人类历史很长一段时间里,写作场景里只有纸笔,打字机的出现,改变了作家与作品之间的关系,也「淘汰」了一批不会使用这类机器并无力承担雇佣打字员的作家。现在这个时间节点,很像打字机开始商业化的十九世纪八十年代,那个时候,马克・吐温刚刚雇佣几个打字员「敲出」了一本 Life on the Mississippi。

哲学家尼采对打字机的表述最具代表性,他因为眼疾而接近全盲,在使用了一年打字机之后向友人感叹:我们的书写工具作用于我们的思想。

或许我们也可以模仿尼采的思考模式,提出下面几个问题:我们在使用大模型进行写作时,这些工具是否正在塑造我们的思考方式?或者更具体地说,我们对这些工具的依赖是否正在改变我们的创作和思考方式?

让时间给出答案吧。